Ett ofta citerat problem i att göra kulturarvssamlingar tillgänglig och sökbara på webben är att vi som katalogiserar föremål, fotografier och andra kulturarvsobjekt använder termer och ett språk som inte faller sig naturligt för ”den vanliga användaren”. När användaren sedan knappar in sina sökord i våra söktjänster matchar de illa med våra termer. Resultatet är att användarna alltför ofta inte finner vad de söker.

I takt med utvecklingen av artificiell intelligens har datorer de senaste åren blivit alltmer kapabla att extrahera information från bilder: nyckelord, känslouttryck i ansikten, färger, m.m. Kan vi kulturarvsinstitutioner använda AI för att göra våra samlingar mera sökbara? Vi bjöd in studenter i systemvetenskap att testa möjligheterna. Två studenter från Uppsala universitet – Alfred Bjersander och Max Collin – antog utmaningen och nedan berättar de om sina resultat.

Vi har på inbjudan under våren tagit fram en prototyp för att göra bilder sökbara baserat på dess innehåll. Projektet resulterade i en webbapplikation som tillgängliggjorts vars källkod finns öppet tillgänglig.

AI:n ser segelfartyg. Skärmdump från prototypen.

Projektets mål var att utveckla en prototyp som kunde visa på eventuella styrkor eller svagheter med att tillföra maskinextraherade attribut till bilder som tillgängliggörs av Riksantikvarieämbetet. Google Vision användes tillsammans med K-samsök för att sammanfoga bildinformation. Resultatet presenteras via en webbapplikation som ger möjlighet att söka i bildmaterialet genom att dels kombinera etiketter samt söka på kombinationer av färger.

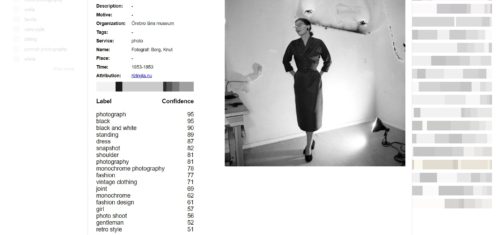

AI:n gör en modeanalys! Skärmdump från prototypen.

En utvärdering av prototypen visar att de tillförda etiketterna ökar möjligheten att framgångsrikt söka i bildmaterialet. Utvärderingen visar också på förekomsten av falska negativ, där bilder inte tillförts den information som förväntas. Kombinationer av valda etiketter kan därför minska antalet träffar där så inte borde vara fallet. Exempelvis minskar antalet träffar om etiketterna “människa“ och “porträtt“ kombineras.

Förmågan att söka bland bilder utifrån färginformation är i K-samsöks befintliga metadata begränsad till manuellt annoterade textfält. Prototypen tillför därför ett nytt sätt att utforska bildsamlingarna genom att kombinera färger.

Prototypen avgränsades till ett slumpmässigt urval om tusen bilder från K-samsök. Även om urvalet inte är så omfattande tycker vi att resultatet visar på hur ett komplement med maskinextraherade attribut kan förbättra sökupplevelsen.

För den som är nyfiken att lära mer om detta arbete finns källkoden och den uppsats vi skrev baserat på detta projekt tillgängliga online.